Accrochez-vous, amis de la Vie Pro Augmentée ! La nouvelle est tombée et elle est… sans appel. La Commission européenne a tranché, et avec quelle fermeté : il n’y aura AUCUN moratoire sur la mise en œuvre de l’AI Act IAPP. Vous avez bien lu. Pas de période de grâce, pas de délai supplémentaire pour respirer. Le compte à rebours est lancé, et pour nos entreprises, cela signifie une chose cruciale : l’heure n’est plus à la réflexion, mais à l’action. Les échéances approchent à grands pas, et les implications sont tout simplement colossales.

Un Calendrier Inflexible : La Fermeté de la Commission

Le refus catégorique d’un moratoire par la Commission européenne est un signal limpide, presque assourdissant. Le calendrier d’entrée en vigueur de l’AI Act est gravé dans le marbre, et sans aucune concession IAPP. Même les systèmes d’IA à usage général (les fameux GPAI) sont dans le viseur, avec une échéance de conformité fixée à août 2025 qui approche à grands pas IAPP.

La mise en œuvre globale ? Elle s’étalera sur environ 36 mois à partir d’août 2024 IAPP, Goodwin. Alors oui, une rédaction d’un code de conduite volontaire pour les fournisseurs de GPAI est envisagée et pourrait être légèrement retardée (fin 2025) IAPP, Goodwin. Mais attention, cela n’affectera en rien le cadre légal strict déjà établi ! Vous voyez l’idée ? Pas de pause, juste une petite adaptation sur un point secondaire.

Premières Étapes Cruciales : Ce Qui Est Déjà en Vigueur

Le compte à rebours est bel et bien terminé pour la première vague de mesures. Imaginez un peu : entré en vigueur le 2 août 2024, le premier train de dispositions a commencé à s’appliquer dès le 2 février 2025 Debevoise Data Blog. Ce n’est plus de la théorie, c’est la réalité !

Ces mesures initiales incluent des interdictions formelles et des exigences fondamentales qui changent déjà la donne :

- Interdiction des systèmes à risque inacceptable : On parle ici de tout ce qui est potentiellement dangereux pour nos droits fondamentaux. Pensez à la notation sociale – oui, comme dans les pires dystopies ! – ou à la surveillance biométrique en temps réel dans les espaces publics à des fins répressives. Mais aussi la catégorisation discriminatoire basée sur des données sensibles, ou encore les IA manipulatrices qui exploitent nos vulnérabilités humaines. C’est clair : ces usages-là sont purement et simplement bannis Debevoise Data Blog, Investopedia. Et c’est une excellente nouvelle, non ?

- Exigences de littératie en IA : C’est une obligation clé, souvent sous-estimée. Les utilisateurs et opérateurs d’IA doivent désormais assurer un degré suffisant de connaissance sur les systèmes d’IA employés Debevoise Data Blog, Investopedia. L’idée ? Favoriser une compréhension éclairée et une utilisation résolument responsable. Fini les boîtes noires !

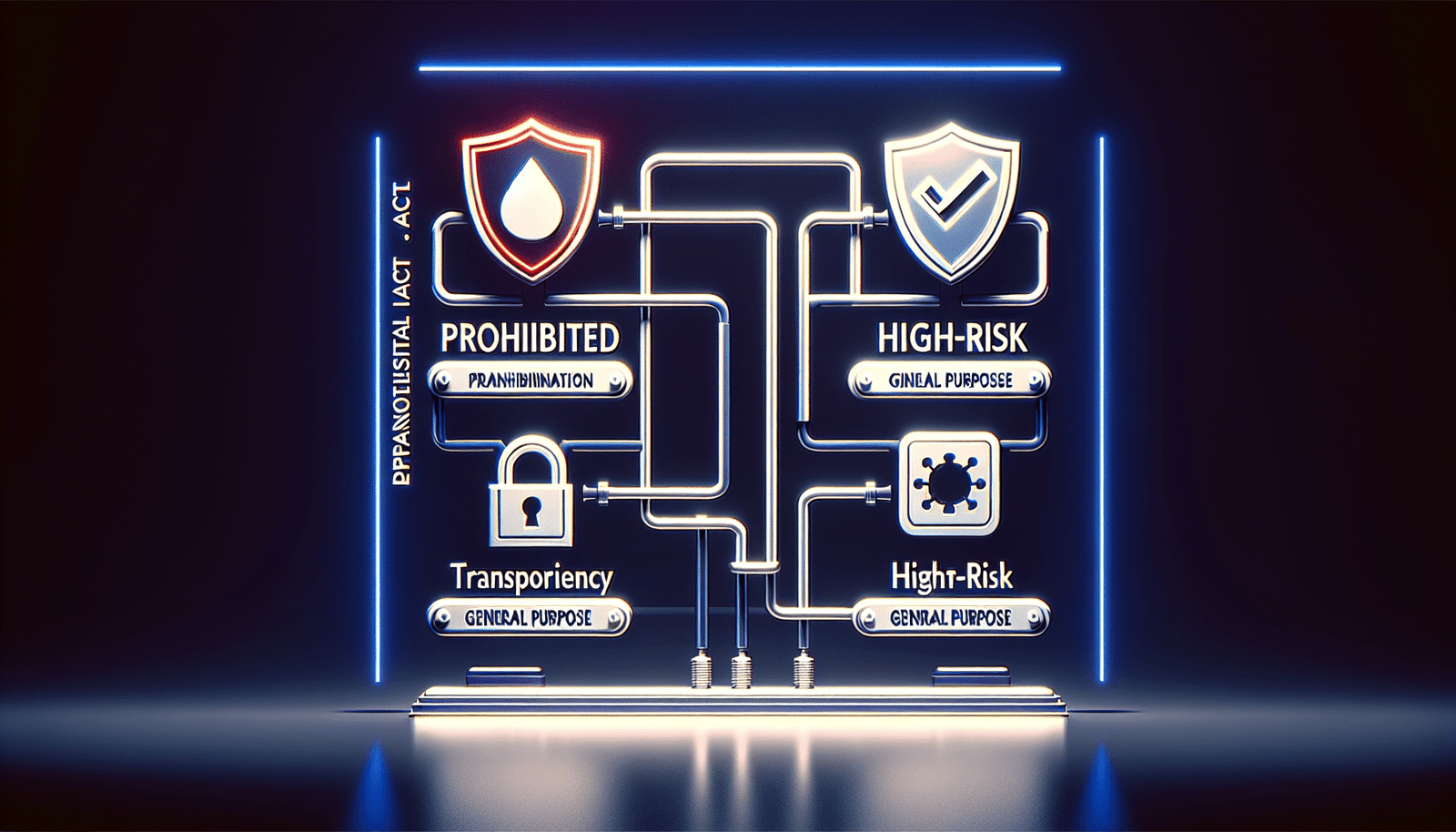

Comprendre les Risques : Une Classification en Quatre Catégories

Ce qui rend l’AI Act si pertinent, c’est son approche pragmatique, astucieusement fondée sur les niveaux de risque. Cette classification est absolument essentielle pour comprendre le degré de conformité requis pour chaque système d’IA que vous utilisez ou développez. Le règlement distingue quatre catégories principales, un peu comme un code couleur pour la dangerosité de vos systèmes Debevoise Data Blog, Goodwin, Investopedia :

- IA prohibée (« unacceptable risk ») : Ces systèmes sont tout simplement interdits, point final. Leur potentiel de nuire aux droits fondamentaux ou à la sécurité est trop grand. On parle de ce que nous avons évoqué plus haut, comme la notation sociale.

- IA à haut risque (« high risk ») : Attention, c’est la catégorie la plus scrutée, celle qui va demander le plus d’efforts ! Elle concerne les systèmes dont l’usage peut avoir des conséquences significatives sur la vie, la santé, la sécurité ou les droits fondamentaux des personnes. Des exemples concrets ? Les IA utilisées pour le scoring de crédit, les infrastructures critiques, la gestion des frontières, la gestion du personnel, ou encore l’application de la loi. Imaginez l’impact d’une IA défaillante dans ces domaines !

- IA avec obligations de transparence : Ici, l’idée est simple mais fondamentale : ces systèmes doivent clairement informer leurs utilisateurs qu’ils interagissent avec une IA. C’est le cas des chatbots, des deepfakes, etc. Pas de surprise !

- IA à usage général (general-purpose AI – GPAI) : C’est une catégorie vaste qui inclut des modèles comme les grands modèles de langage que vous utilisez probablement tous les jours. Ils sont soumis à des exigences spécifiques, certes, mais moins contraignantes que les IA à haut risque.

AI à Haut Risque et Usage Général : Les Prochaines Grandes Étapes

Si certaines mesures sont déjà ancrées dans notre quotidien, d’autres échéances cruciales se profilent à l’horizon, et il est vital de les avoir en tête :

- Août 2025 : Les fournisseurs de systèmes d’IA à usage général devront se conformer à des exigences spécifiques, notamment la rédaction de ce fameux code de conduite volontaire IAPP, Goodwin. Ça arrive vite !

- Août 2026 : Et là, le gros morceau ! Les systèmes d’IA à haut risque seront soumis à des contrôles stricts Debevoise Data Blog, Goodwin, Investopedia. Qu’est-ce que ça implique ? Un ensemble d’obligations rigoureuses : des tests approfondis, une documentation détaillée comme jamais, une surveillance post-commercialisation continue, et surtout, un contrôle humain significatif. Fini le « set it and forget it » !

Les Sanctions : Un Avertissement Solennel

Alors, une petite piqûre de rappel qui fait mal : la non-conformité à l’AI Act ne sera pas une simple tape sur les doigts. Les sanctions financières prévues sont particulièrement dissuasives, et c’est le moins qu’on puisse dire ! Elles peuvent atteindre jusqu’à 35 millions d’euros ou… 7% du chiffre d’affaires global de l’entreprise, selon le montant le plus élevé Goodwin. 7% du chiffre d’affaires, vous vous rendez compte de ce que ça représente pour les mastodontes de la tech ? Cette rigueur souligne l’importance capitale que la Commission accorde à cette réglementation et à son respect. Ce n’est pas une blague, c’est du sérieux !

Vers une Conformité Accompagnée ? L’Aide Promise

Consciente que cette mise en conformité représente un véritable défi pour les entreprises, la Commission européenne a quand même une bonne nouvelle : elle a annoncé la création prochaine d’un service d’assistance dédié IAPP. Son but ? Aider les entreprises à naviguer dans les méandres du règlement AI Act et à assurer leur conformité. C’est un signe positif, une main tendue pour ceux qui se sentent un peu perdus. Mais ne vous y trompez pas : cela ne remplace en rien votre propre proactivité !

Préparez Votre Entreprise : Agir Dès Maintenant

Le message est d’une clarté cristalline : la marche forcée de l’AI Act est irréversible. L’absence de moratoire, l’application progressive des mesures et l’approche stricte de la Commission exigent une préparation immédiate et proactive. Il est impératif pour chaque entreprise, quelle que soit sa taille ou son secteur, de :

- Évaluer ses systèmes d’IA existants : Où vous situez-vous sur l’échelle des risques de l’AI Act ? C’est la première question à se poser, et elle est cruciale.

- Comprendre les obligations spécifiques : Chaque catégorie de risque vient avec son lot d’exigences. Les connaissez-vous toutes ?

- Mettre en place des processus internes robustes : Documentation, tests, surveillance… Il faut que tout soit huilé pour assurer une conformité à toute épreuve.

- Sensibiliser et former vos équipes : L’IA Act, ce n’est pas que l’affaire des juristes ou des data scientists. Toute l’entreprise doit être au courant des principes et des impératifs.

L’AI Act n’est pas une simple formalité administrative ; c’est une transformation profonde de la manière dont l’IA sera développée et utilisée en Europe. Alors, mon conseil d’ami : anticipez, agissez, et surtout, transformez cette apparente contrainte en une opportunité fantastique de construire des systèmes d’IA non seulement plus fiables, mais aussi plus éthiques et, au final, plus performants. Le futur de l’IA en Europe est déjà là, et il nous appartient de le façonner intelligemment !

[IMAGE_PROMPT: Une équipe de professionnels diversifiée, travaillant activement autour d’une table avec des laptops et des documents. L’atmosphère est celle de la collaboration et de la détermination. En arrière-plan, des schémas d’IA complexes se superposent discrètement, symbolisant l’intégration de la technologie et la nécessité de conformité.].

Antoine Pelletier explore l’intelligence artificielle au quotidien. Il teste, analyse et partage les outils les plus utiles pour simplifier la vie, gagner du temps ou simplement mieux comprendre ce qui nous attend. IA au Quotidien est son terrain d’expérimentation — et de transmission.